一方で、誤情報の拡散、差別的判断、権利侵害、個人情報漏えいなど、AIの負の側面も顕在化している。こうした背景のもと、日本政府は2025年9月1日、「AI法」と通称される新法を全面施行した。本稿では、AI法の全体像と制定背景、特徴、企業・人事部門に求められる具体的な対応策までを体系的に解説する。

AI法の概要――制定背景と基本理念

まずは、AI法の概要から紐解いていこう。●AI法とは

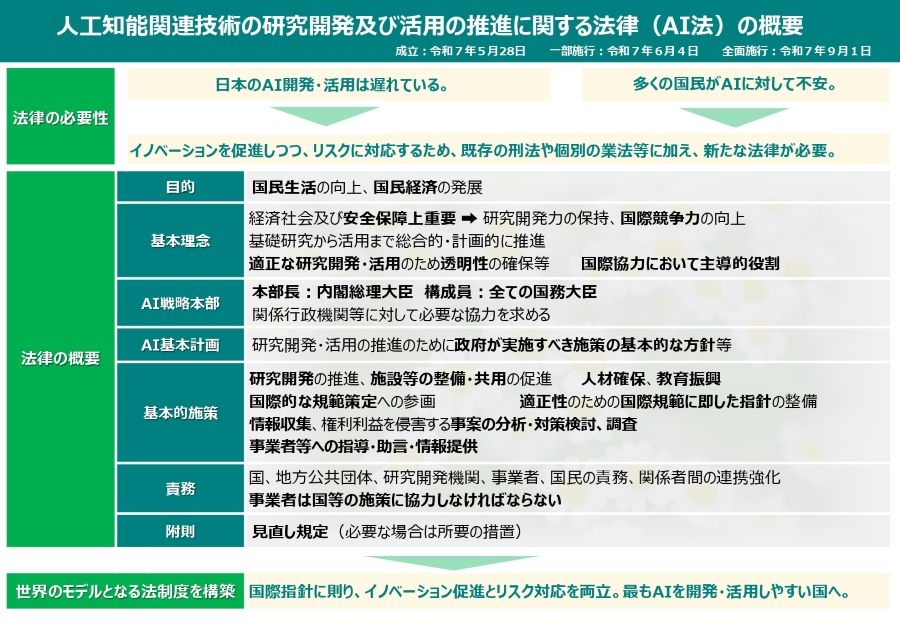

「AI法」の正式名称は「人工知能関連技術の研究開発及び活用の推進に関する法律」である。2025年6月4日に大部分が施行、同年9月1日に全面施行された、日本初のAI基本法だ。本法は、AI技術の研究開発および活用を「総合的・計画的に推進する」ための枠組みを定めた“推進法”であり、AI活用を禁止・制限することを主目的とするものではない。「イノベーション促進とリスク対応」の両立を掲げ、国家戦略としてAIの活用基盤を整備することが狙いとなる。

HRプロなら、最新の「人的資本経営」から「AI活用」まで、専門家による深掘りレポートや最新調査データ、大手企業の事例記事が読み放題。業務課題解決のサービス情報や導入事例など、ソリューション選定に役立つ資料もダウンロード可能です。

10万人以上の人事担当者が利用する日本最大級の人事ポータルを、ぜひ情報収集にお役立てください。

【完全無料】会員登録して最新のHR情報を網羅する(メールアドレスのみで登録完了) >>

●AI法制定の背景と二つの目的

なぜ今、AI法が必要だったのか。AI法制定の背景には、主に次の二点がある。(1)国際競争力への危機感

AI分野では米国や中国、欧州が巨額投資を行い、技術主導権争いを加速させている。日本は高度な研究基盤を有する一方、社会実装やビジネス展開で遅れが指摘されてきた。政府はAIを次世代産業の中核と位置づけ、国家としての方向性を明確に示す必要に迫られていた。

(2)AIリスクへの社会的懸念

生成AIによる虚偽情報(ディープフェイク、ハルシネーション)、アルゴリズムバイアス、プライバシー侵害などへの不安が高まっている。「AIを安全に利用できるのか」「AIには規制が必要なのでは」などといった国民の声に応えるには、既存法制度のみでは対応が不十分ゆえ、新たな法律が不可欠であるという認識が広がった。

本法の目的は「国民生活の向上」と「国民経済の発展」だ。そのためにも、国際指針に則り、「イノベーションの促進とリスク対応」の両立を国家戦略として明確に掲げている。AIの利活用による経済成長と社会課題解決を推進しつつ、適切なリスク対応を通じて国民の信頼を確保する。すなわち、“成長”と“信頼”の両立が根幹にある。日本政府が目指しているのは、AIに関する世界のモデルとなる制度の構築。世界で最もAIを開発・活用しやすい国を作っていきたいと考えている。

・「ソフトロー」的アプローチの経緯

AI法の大きな特徴は、「ソフトロー」的なアプローチを採用している点だ。罰則規定を設けず、行政指導・助言を通じて事業者の自主的な取り組みを促す設計となっている。なぜなら、過度な規制がイノベーションを阻害することを避けるためだ。これは、義務違反に対して巨額の制裁金を科す欧州のEU AI Act(EU AI規制法)とは対照的なモデルである。日本は過度な規制によるイノベーション阻害を割け、まずは「環境整備と官民協調」を重視する立場を採ったことになる。

・EU AI Act:ハイリスクAIへの厳格な義務、違反には最大3,500万ユーロ(または全世界年間売上高の7%)の制裁金

・日本AI法:罰則なし・自主的取り組みを推進・ガイドラインによる指導

グローバル展開する企業は、EU規制との整合性も並行して検討が必要となる。

●AI法の基本理念

AI法は、AIの研究開発および活用を推進に向けた基本的な考え方として、幾つかの基本理念を掲げている。中核となるのは、研究開発力の保持、国際競争力の向上、基礎研究から活用までの総合的・計画的な推進、適正な研究開発・活用のための透明性の確保、国際協力における主導的な役割だ。・AI法における「人工知能関連技術(AI関連技術)」の定義

AI法では「人工知能(AI)関連技術」を広く定義している。大別すると二つ。1.人工的な方法により人間の認知・推論・判断能力を代替する機能を実現する技術

2.入力された情報を処理・出力する機能を実現する情報処理システムに関する技術

機械学習やディープラーニング、自然言語処理のみならず、それらを活用した業務システムやサービスも含まれる可能性がある。そのため、自社が取り扱う業務システムやサービスが、この定義に該当する可能性があるかどうかを確認するようにしたい。人事部門が利用するHRテックは、AI法の射程に入る可能性が高い。

AI法の主な内容

次に、AI法の具体的な内容について解説していく。●「AI戦略本部」の設置と「AI基本計画」の策定

AI法では、国がAI関連技術の研究開発や活用を総合的・計画的に管理するために、AI政策を統括する司令塔として内閣府に「人工知能戦略本部(AI戦略本部)」を設置することを定めている。本部長は内閣総理大臣が務め、全閣僚が構成員に名を連ねている。その重要な任務の一つが、AIに関する国の基本的な計画である「人工知能基本計画(AI基本計画)」の策定・更新だ。ここで、研究開発支援、社会実装促進、人材育成、国際連携など、政府施策の方向性が示される。企業にとっては、補助金・助成制度、重点分野、将来的な規制動向を把握するための重要な指針となる。

●ガイドラインの整備と国際協調

「AI基本計画」は、国としてのAI戦略の根幹となる。当然ながら、各省庁が実施する個別施策は、これに準拠するだけでなく、民間事業者や研究機関にとっても自らの研究開発活動や事業戦略を策定する際の重要なガイドラインとなる。また、AIは国境を越えて展開される技術である。そのため、海外規範との整合性確保や国際協調が不可欠だ。特にEUでは、包括的なAI規制法が段階的に適用されている。グローバルに事業展開する企業は、日本法のみならず海外規制への適合も視野に入れなければならない。人事システムが海外拠点で利用される場合、アルゴリズムの透明性や説明可能性が問われる可能性もある。

●関係者別の責務

AI法では、国、地方公共団体、研究開発期間、企業などに対して明確な責務・役割を定めている。AI技術の健全な発展と社会実装を社会全体で支えていこうと考えているからだ。・国の責務

AI法に基づいて、国は総合的・計画的な推進、国際連携、政策整備を行う役割を担っている。具体的には時流に合わせた法律の見直しや「AI戦略本部」の設置、国際連携に関する取り組みなどが挙げられる。目指すは、適正な技術活用や国際競争力の強化であるだけに、企業の海外進出やグローバル展開を後押ししてくれるはずだ。・地方公共団体の責務

地方公共団体には、国と役割を分担しながら地域特性を踏まえた施策を策定・展開する責務がある。例えば、地域の産業特性とAIを掛け合わせることで、地域の課題解決に結び付けていく取り組みも想定される。地方公共団体がハブとなり、企業や大学とのプロジェクトを加速させる動きも期待できる。・研究開発機関(大学、研究開発法人等)の責務

研究開発機関の役割は人材育成と学際的研究の推進だ。AI関連技術の研究開発や成果の普及に向けて人材の育成に努めるとともに、国や地方公共団体が実施する施策に協力しなければいけない。また、AI関連技術の研究開発を効果的に進めるためにも、多様な分野の知見を総合的に活用する必要があるため、学際的・総合的な研究開発が求められている。・活用事業者(企業)の責務

AI技術の活用事業者とは、「人工知能関連技術を活用した製品又はサービスの開発又は提供をしようとする者」「その他の人工知能関連技術を事業活動において活用しようとする者」と定義されている。これらの活用事業者(企業)には、自社のビジネスに合致した形でAIを導入するとともに、国や地方公共団体の施策に協力する役割も求められる。具体的には大きく二点ある。一つが、自ら積極的にAI関連技術を活用することで、事業活動の効率化や高度化、新産業の創出に努めること。もう一つが、開発段階からセキュリティ対策や透明性の確保を徹底しながら、公的機関が行う調査研究にも協力する姿勢だ。より安全かつ有益なAI活用を実現するためには、そうした責務を果たすことが重要となってくる。

・国民の責務

国民は基本理念に則り、AI関連技術に対する理解と関心を深めるとともに、国や地方公共団体が実施する施策に協力することが求められている。●罰則はないが「行政指導や企業名公表リスク」に要注意

AI法自体に刑事罰や課徴金は設けられていない。なぜなら、法規制によりAI活用促進が滞ることを懸念しているからだ。しかし、行政指導への不応答や重大な不適切事例があれば、企業名公表や補助金停止などの措置が取り得るとされている。レピュテーションリスクは企業価値に直結する。特に人事領域で不公正なAI利用が発覚した場合、社会的信頼の失墜は避けられない。企業が直面する「3つのリスク」と新法の関係

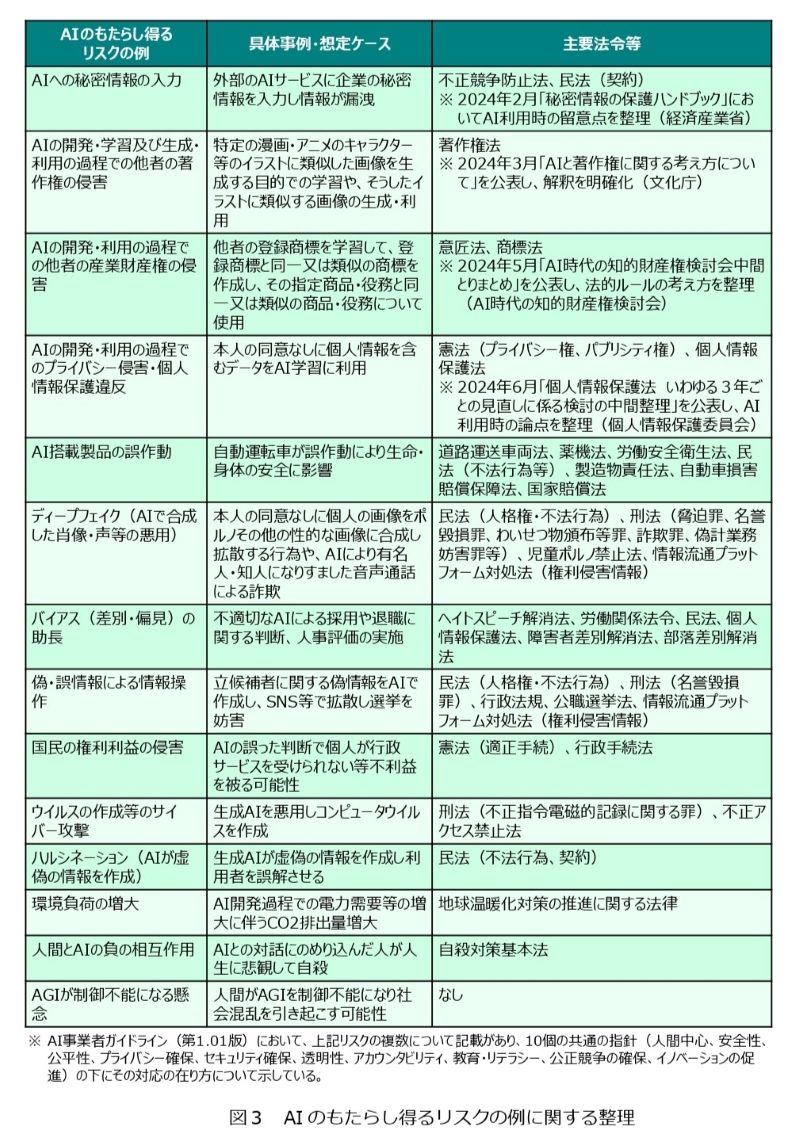

AI法の施行により、企業が講じるべき対応の輪郭は明確になりつつある。しかし実務の現場では、法律論より先に「具体的にどんなリスクが自社に降りかかるのか」を把握することが重要だ。ここでは、人事・経営が特に直面しやすい3つのリスクと、AI法との関係を整理する。(1)権利侵害リスク:著作権・機密情報保護の法解釈

生成AIは、大量のテキストや画像を学習データとして取り込んでいる。そのため、AIが生成したコンテンツに他者の著作物が意図せず混入するリスクは常に存在する。採用資料の作成や社内文書の自動生成にAIを活用する場合、著作権侵害のリスクを軽視することはできない。また、業務上の機密情報や顧客データをAIツールに入力することで、意図せず外部サーバーへデータが送信されるケースも報告されている。AI法は権利侵害を直接規制する法律ではないが、「適正な研究開発・活用のための透明性の確保」を基本理念に掲げており、自社のAI利用が適法かどうかの自主点検が企業に求められている。利用規約の精査と社内ルールの整備が急務だ。

(2)倫理・差別リスク:採用や人事評価におけるAI利用の注意点

採用スクリーニングや人事評価にAIを活用する場合、アルゴリズムに内在するバイアスが差別的な判断を生む恐れがある。たとえば、過去の採用実績データを学習したAIが、特定の性別・年齢・出身校に偏った評価を下すケースは、すでに海外企業で問題化している。AI法は「公正な活用」を基本理念に掲げており、こうした倫理リスクは法的問題に発展する前に自社で対処することが求められる。人事領域のAI活用では、最終判断を人間が担う設計が不可欠だ。また、従業員や応募者に対して「どのようにAIが判断に関与しているか」を説明できる体制を整えることが、信頼確保の観点からも重要となる。

(3)セキュリティリスク:シャドーAI(会社非公認の利用)の防止

社員が会社の許可なく外部の生成AIツールを業務に使用する、いわゆる「シャドーAI」は、多くの企業で深刻な問題となっている。機密情報や個人情報が無許可のクラウドサービスに流出するリスクに加え、AIが生成した不正確な情報を検証なく業務に使用することで、意思決定の質が低下する恐れもある。AI法では活用事業者(企業)に対し、「開発・活用段階からセキュリティ対策を徹底する」責務が明記されている。シャドーAIの防止には、禁止一辺倒の対応より、社員が安心して使える公認ツールの整備と明確な利用ガイドラインの策定が効果的だ。「使わせない」ではなく「正しく使わせる」という発想の転換が、リスク低減と生産性向上の両立につながる。

なお、2025年2月に公開された、AI 戦略会議・AI制度研究会「中間とりまとめ」では、AIがもたらしうるリスクの例に関する整理がなされている。参考として紹介しておきたい。

企業・人事に求められる対応――4つの社内整備

ここからは、AI法に対して企業や人事がどう向き合っていけば良いかを述べたい。●AIガバナンス体制(AI委員会など)の構築とリスク評価

まずは、経営レベルでAI活用方針を明確化し、ガバナンス体制を整備することが出発点となる。具体的には以下のような制度の整備が有効となる。・経営直轄のAI委員会(またはAI倫理委員会)の設置

・Chief AI Officer(CAO)などAI責任者の任命

・法務・人事・コンプライアンス・IT部門を含む横断的体制の構築

・リスクアセスメントプロセスの明確化と継続的なリスク評価

・外部監査・第三者評価の導入検討

AI導入はIT部門任せにせず、法務・人事・コンプライアンス部門を含む横断的体制を構築し、「誰が最終責任を負うのか」を明確にすることが最重要である。

●著作権・個人情報を守るAI利用ガイドラインの整備

AI活用で最も注意すべき領域の一つがデータ管理だ。特に、著作権や個人情報保護の観点で学習データの収集・利用段階で問題が起こりやすいため、以下の点は徹底したい。学習データの出所確認と利用許諾の取得

個人情報の適法な収集・利用(個人情報保護法遵守)

目的外利用の防止と、匿名化・仮名化措置の実施

採用AIや人事評価AIにおける説明責任(アルゴリズム説明義務)の確保

採用・人事評価にAIを活用する場合、応募者・従業員の個人情報を大量に扱うため、「なぜその判断が下されたか」を説明できる透明性が不可欠となる。透明性が担保できなければ、信頼は得られない。

●従業員のAIリテラシー向上とリスキリングの推進

AIの誤出力(ハルシネーション)を鵜呑みにするリスクは大きい。そのため、AI法でも国民のAIリテラシー向上を重視している。企業も従業員教育を強化すべきだ。具体的には、以下のような情報セキュリティ教育やプロンプト設計研修を実施するのが有益となる。・情報セキュリティ研修・プロンプトエンジニアリング研修

・AIの仕組みと限界(ハルシネーション・バイアス等)への理解促進

・AIの出力に対して批判的に検証する習慣の醸成

・管理職層を対象にしたAI倫理・ガバナンス研修

いずれも、単なる操作研修ではなく、AIの仕組みと限界の理解を促すとともに出力結果に対して批判的に検証し、AIを「使いこなす力」を醸成することが競争優位につながる。特に、管理職こそAI理解を深める必要があるだろう。

●組織横断的な推進体制とAI人材の確保

AI法に対応するために、企業では自社内でのAI活用に関する組織体制を整備しなければいけない。・AI戦略委員会の設置と経営との連携強化

・部門横断プロジェクト体制の構築(人事×IT×法務×事業部)

・データサイエンティスト・AIエンジニアの採用強化

・社内リスキリングプログラムへの投資拡大

・外部パートナー(AIコンサル・法律事務所)との連携

ただ、AI人材の市場競争は激化しており、慢性的な不足が続いている。「外注依存」だけでは競争力は持続しない。内製化とアウトソーシングのハイブリッド戦略が効果的と言えるだろう。

人事・マネージャーが今すぐ確認すべき4つのチェックポイント

採用・評価・配置など多岐にわたる人事業務でAIを活用する際、法令遵守はもちろん、社員や候補者からの信頼を確保するも重要な課題となる。ここでは、マネージャーや人事担当者が今すぐ確認すべき4つのチェックポイントを整理していきたい。(1)透明性の確保と政府施策への協力

人事領域でAIを利用する際には、運用実態の透明性を確保し、政府の調査・評価に協力できる体制を整える必要がある。(2)個人情報・プライバシー保護の徹底

AIを人事領域で使う場合、 個人情報の取り扱いに関する法令遵守が必須となる。個人情報の収集・利用が適法に行われているかどうか、というリスク管理が重要となる。(3)社内AIガバナンス体制の整備

今後、政府はより具体的なルールを策定していくと見込まれている。それに合わせて、企業独自のAI利用ポリシーを策定するようにしたい。(4)海外規制との整合性への配慮

日本のAI法は罰則がないが、EUなどでは厳しい義務や制裁が導入されるAI規制が進んでいる。グローバルにAIを展開する企業は、国際規制との整合性も人事システムの設計時に検討しておくようにしたい。【関連記事】人事業務でのAI活用事例を紹介! 活用領域・導入メリット・注意点も解説

【関連記事】人事評価へのAI活用のメリットとデメリットは? 導入事例や今後の展望を解説

まとめ

AI法は、AIの活用を禁止・制限するための法律ではなく、日本がAI活用の世界モデルとなるための国家戦略法と言える。今後、AIを戦略的に活用できる企業と、リスク対応に後れを取る企業との差は拡大するだろう。人事・経営が主導し、透明性・説明責任・ガバナンスを確立したうえでAIを導入できるかが、競争優位の分水嶺となる。AI法対応はコンプライアンス対応にとどまらない。それは、企業の持続的成長を左右する経営テーマである。

また、すでに、採用や評価、エンゲージメント分析ツールなど、AIを採用したHRテックを活用している企業は今すぐAI法への対応状況を確認すべきだ。「使っているシステムがAI法の射程に入るか」「個人情報の取り扱いは適法か」「説明責任を果たせる体制か」、この三点から始めることを推奨したい。

HRプロなら、最新の「人的資本経営」から「AI活用」まで、専門家による深掘りレポートや最新調査データ、大手企業の事例記事が読み放題。業務課題解決のサービス情報や導入事例など、ソリューション選定に役立つ資料もダウンロード可能です。

10万人以上の人事担当者が利用する日本最大級の人事ポータルを、ぜひ情報収集にお役立てください。

【完全無料】会員登録して最新のHR情報を網羅する(メールアドレスのみで登録完了) >>

- 1